論文解説 Attention Is All You Need (Transformer)

こんにちは Ryobot (りょぼっと) です.

本紙は RNN や CNN を使わず Attention のみ使用したニューラル機械翻訳 Transformer を提案している.

わずかな訓練で圧倒的な State-of-the-Art を達成し,華麗にタイトル回収した.

また注意を非常にシンプルな数式に一般化したうえで,加法注意・内積注意・ソースターゲット注意・自己注意に分類した.このうち自己注意はかなり汎用的かつ強力な手法であり他のあらゆるニューラルネットに転用できる.

WMT'14 の BLEU スコアは英仏: 41.0, 英独: 28.4 で第 1 位

- Attention Is All You Need [Łukasz Kaiser et al., arXiv, 2017/06]

- Transformer: A Novel Neural Network Architecture for Language Understanding [Project Page]

- TensorFlow (著者ら)

- Chainer

- PyTorch

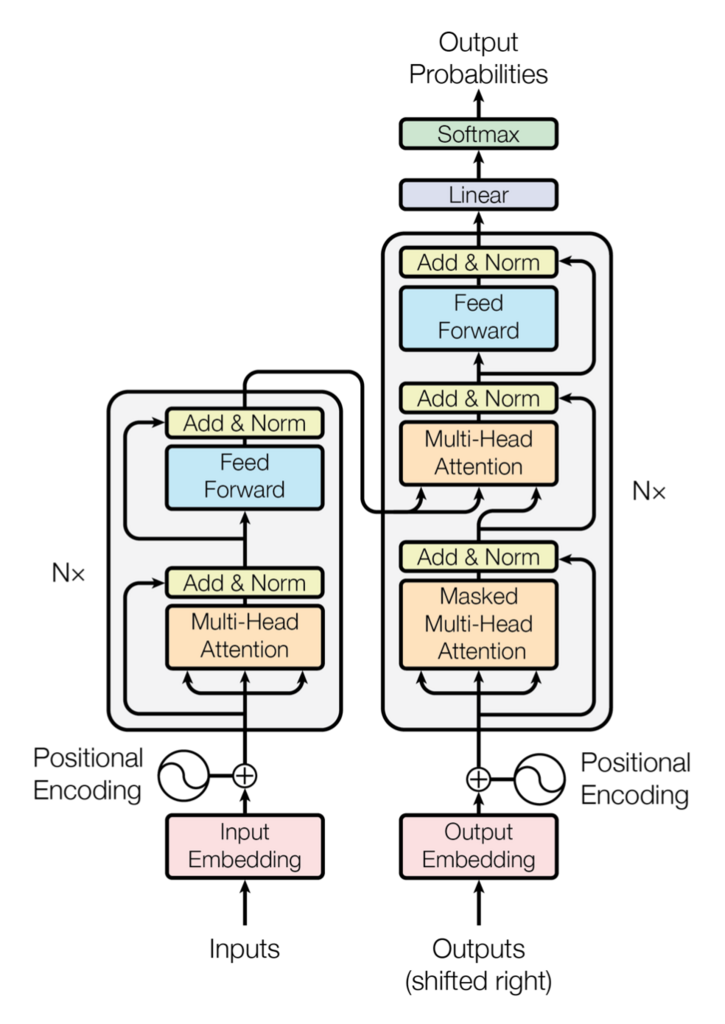

左側がエンコーダ,右側がデコーダである.それぞれ灰色のブロックを 6 個スタックしている ().

- エンコーダ: [自己注意, 位置毎の FFN] のブロックを 6 層スタック

- デコーダ: [(マスキング付き) 自己注意, ソースターゲット注意, 位置毎の FFN] のブロックを 6 層スタック

ブロック内は残差接続 (Residual Connection) と層正規化 (Layer Normalization) を適応する.

Transformer の詳細に入る前に,注意について再考したい.

注意は辞書オブジェクト

一般的な Encoder-Decoder の注意はエンコーダの隠れ層を ,デコーダの隠れ層を

として次式によって表される.

より一般化すると を

(検索クエリ) と見做し,

を

と

に分離する.

これ以降,イニシャルが小文字の (ないし

) はベクトル,大文字の

(ないし

) は行列 (ベクトルの配列) を表す.

この時 と

は各

と各

が一対一対応する key-value ペアの配列,つまり辞書オブジェクトとして機能する.

と

の内積は

と各

の類似度を測り,softmax で正規化した注意の重み (Attention Weight) は

に一致した

の位置を表現する.注意の重みと

の内積は

の位置に対応する

を加重和として取り出す操作である.

つまり注意とは (検索クエリ) に一致する

を索引し,対応する

を取り出す操作であり,これは辞書オブジェクトの機能と同じである.例えば一般的な Encoder-Decoder の注意は,エンコーダのすべての隠れ層 (情報源)

から

に関連する隠れ層 (情報)

を注意の重みの加重和として取り出すことである.

の配列

が与えられれば,その数だけ key-value ペアの配列から

を取り出す.

Memory を Key と Value に分離する意味

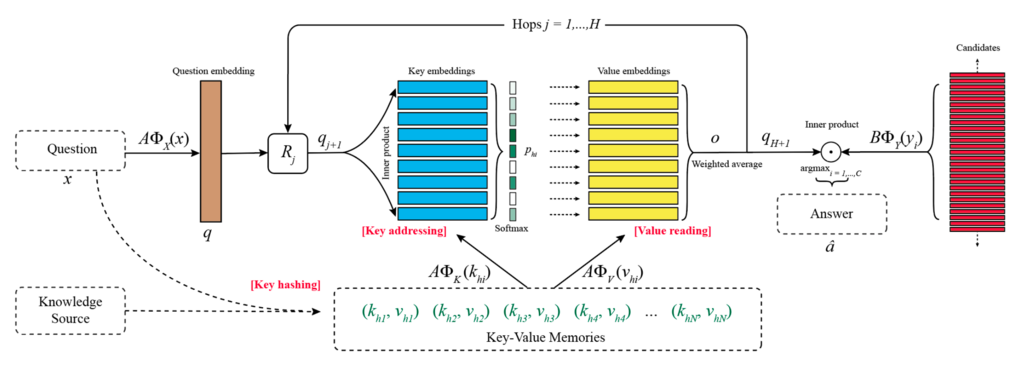

key-value ペアの配列の初出は End-To-End Memory Network [Sukhbaatar, 2015] であるが, を

,

を

(両方を合わせて

) と表記しており,辞書オブジェクトという認識はなかった.

初めて辞書オブジェクトと認識されたのは Key-Value Memory Networks [Miller, 2016] である.

- End-To-End Memory Networks [Sainbayar Sukhbaatar, sec-last: Jason Weston, arXiv, NIPS, 2015/03]

- Key-Value Memory Networks for Directly Reading Documents [Alexander Miller, last: Jason Weston, arXiv, 2016/06]

Key-Value Memory Networks では key-value ペアを文脈 (e.g. 知識ベースや文献) を記憶として格納する一般的な手法だと説明している. を

と

に分離することで

と

間の非自明な変換によって高い表現力が得られるという.ここでいう非自明な変換とは,例えば「

を入力して

を予測する学習器」を容易には作れない程度に複雑な (予測不可能な) 変換という意味である.

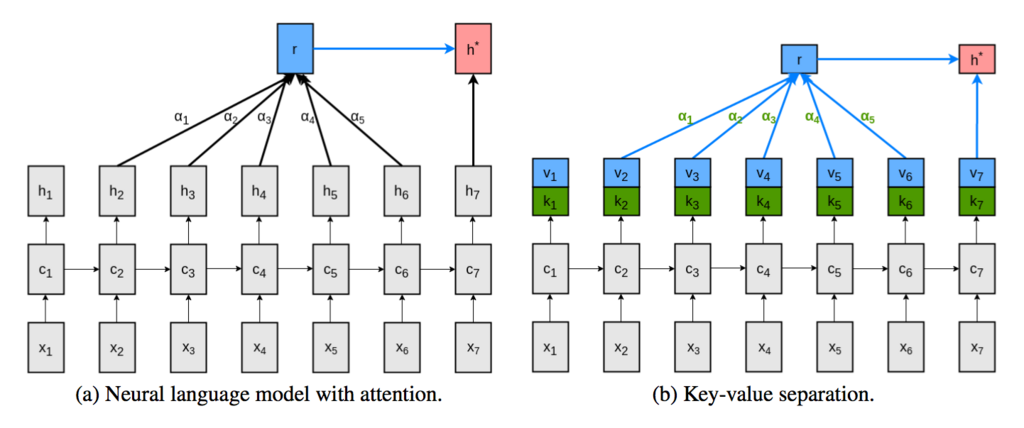

その後,言語モデルでも同じ認識の手法 [Daniluk, 2017] が提案されている.

- Frustratingly Short Attention Spans in Neural Language Modeling [Michał Daniluk, arXiv, ICLR, 2017/02]

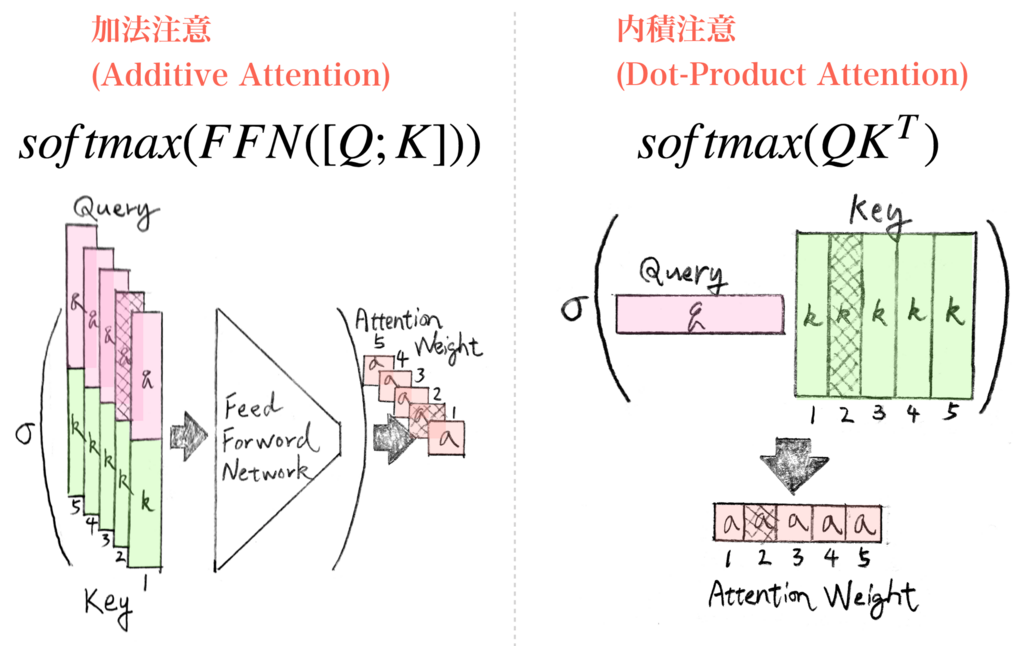

加法注意と内積注意

注意は「注意の重みの求め方」によって加法注意と内積注意に区分される.

加法注意 (Additive Attention) [Bahdanau, 2014] は注意の重みを隠れ層 1 つのフィードフォワードネットワークで求める.

内積注意 (Dot-Product Attention, Multiplicative Attention) [Luong, 2015] は注意の重みを内積で求める.一般に内積注意の方がパラメータが必要なく (故にメモリ効率も良く) 高速である.Transformer はこちらを使う.

- Neural Machine Translation by Jointly Learning to Align and Translate [Dzmitry Bahdanau, sec: Kyunghyun Cho, last: Yoshua Bengio, ICLR 2015, arXiv, 2014/09]

- Effective Approaches to Attention-based Neural Machine Translation [Minh-Thang Luong, arXiv, 2015/08]

ソースターゲット注意と自己注意

注意は「入力がどこから来るのか」によってソースターゲット注意と自己注意に区分される.

ソースターゲット注意 (Source-Target-Attention) では と

はエンコーダの隠れ層 (

) から来て,

はデコーダの隠れ層 (

) から来る.一般的な Encoder-Decoder の注意はこちらである.前述のとおり

は

とも呼ばれ,

と

は

を 2 つに分離したものと解釈できる.

自己注意 (Self-Attention) では は全て同じ場所 (

) から来る.例えばエンコーダの

はすべて下の隠れ層から来る.

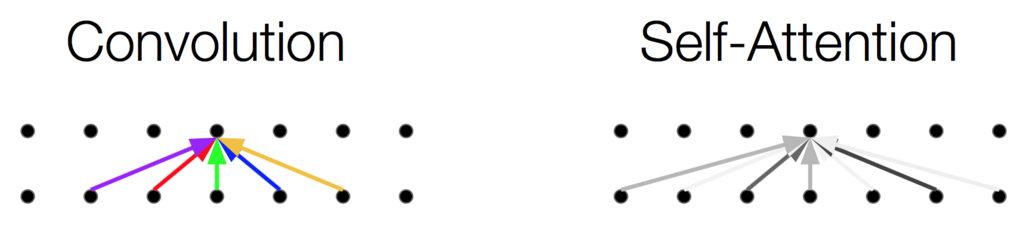

自己注意はある位置の出力を求めるのに下の隠れ層の全ての位置を参照できる.これは局所的な位置しか参照できない畳み込み層より優れた利点である.

従来の注意モデルでは 1 度の注意に 1 つの しか与えられない (e.g. RNNsearch, MemN2N).しかし,デコーダの

が同時に与えられる場合,もしくは

が同時に与えられる自己注意では,それぞれ同時に注意を実行し,

と同数の出力ベクトルをまとめて得られる.

Transformer

モデルは至ってシンプルである.

- エンコーダ: [自己注意, 位置毎の FFN] のブロックを 6 層スタック

- デコーダ: [(マスキング付き) 自己注意, ソースターゲット注意, 位置毎の FFN] のブロックを 6 層スタック

ネットワーク内の特徴表現は [単語列の長さ x 各単語の次元数] の行列で表される.注意の層を除いて 0 階の各単語はバッチ学習の各標本のように独立して処理される.

訓練時のデコーダは自己回帰を使用せず,全ターゲット単語を同時に入力,全ターゲット単語を同時に予測する.ただし予測すべきターゲット単語の情報が予測前のデコーダにリークしないように自己注意にマスクをかけている (ie, Masked Decoder).評価/推論時は自己回帰で単語列を生成する.

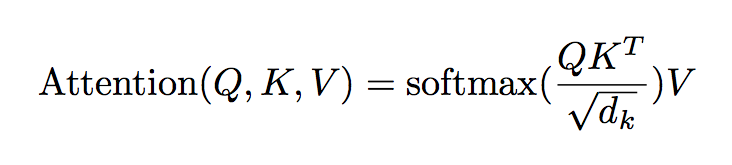

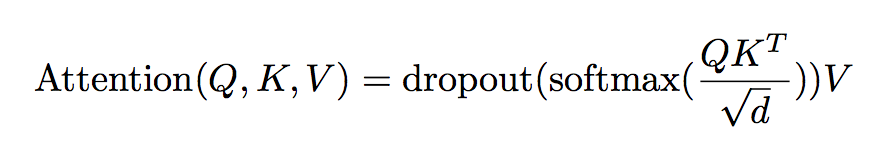

縮小付き内積注意

Transformer では内積注意を縮小付き内積注意 (Scaled Dot-Product Attention) と呼称する.通常の内積注意と同じく をもとに key-value ペアの配列から加重和として

を取り出す操作であるが,

と

の内積をスケーリング因子

で除算する.

また, の配列は 1 つの行列

にまとめて同時に内積注意を計算する (従来通り

と

の配列も

にまとめる).

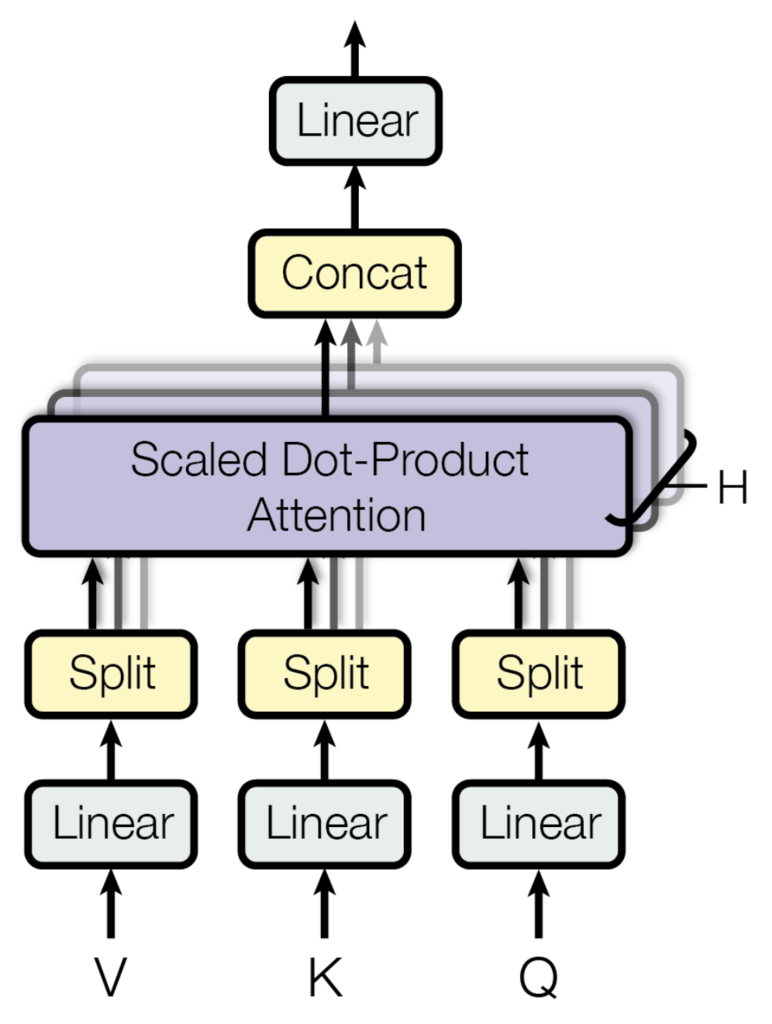

縮小付き内積注意は次式によって表される.

が小さい場合,スケーリング因子がなくても内積注意は加法注意と同様に機能する.しかし

が大きい場合,スケーリング因子がないと加法注意の方がうまく機能する.内積注意は内積が大きくなりすぎて,逆伝播の softmax の勾配が極端に小さくなることが原因である.

| Scaled Dot-Product Attention | Multi-Head Attention |

|---|---|

|

|

Mask (option) はデコーダの予測すべきターゲット単語の情報が予測前のデコーダーにリークしないように自己注意にかけるマスクである (Softmax への入力のうち自己回帰の予測前の位置に対応する部分を で埋める).

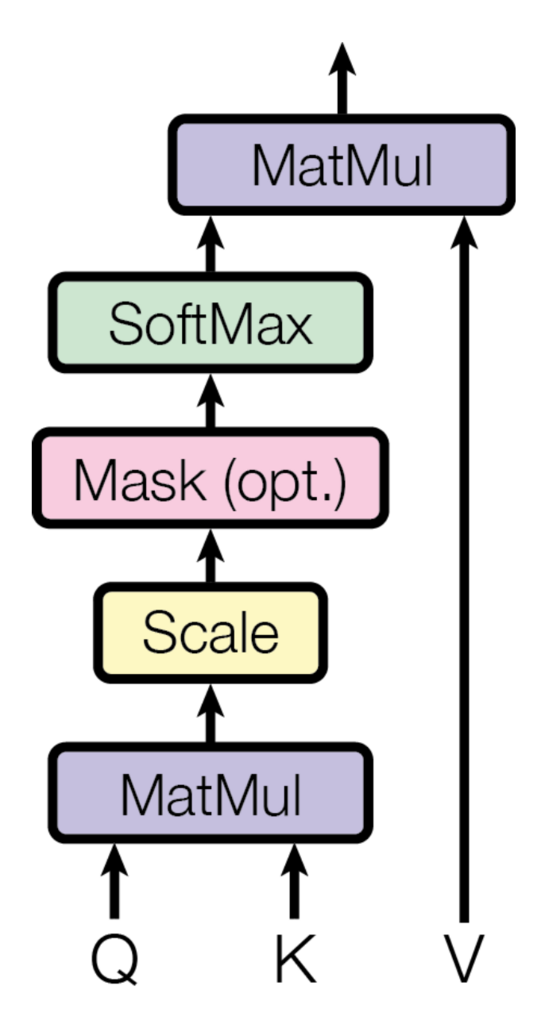

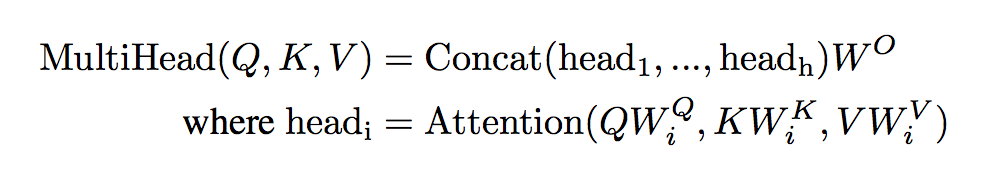

複数ヘッドの注意

Transformer では縮小付き内積注意を 1 つのヘッドと見做し,複数ヘッドを並列化した複数ヘッドの注意 (Multi-Head Attention) を使用する.ヘッド数 と各ヘッドの次元数

はトレードオフなので合計のパラメータ数はヘッド数に依らず均一である.

次元の

を用いて単一の内積注意を計算する代わりに,

をそれぞれ

回異なる重み行列

で

次元に線形写像して

個の内積注意を計算する.各内積注意の

次元の出力は連結 (concatenate) して重み行列

で

次元に線形写像する.

複数ヘッドの注意は次式によって表される.

ここで はすべての層の出力の次元数,

は

と

の次元数,

は

の次元数である.

実験的に複数ヘッドの注意の方が単一の注意より性能が高いことが判明した.複数ヘッドの注意は各ヘッドが異なる位置の異なる部分空間を処理すると解釈でき,単一の注意は加算がこれを妨げてしまう.

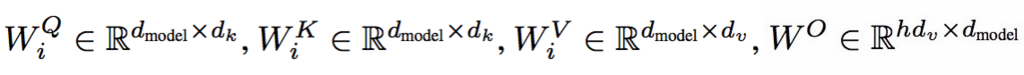

位置毎のフィードフォワードネットワーク

位置毎のフィードフォワードネットワーク (Position-wise Feed-Forward Network, FFN) はその名のとおり単語列の位置毎に独立して処理する FFN である.

FFN は次式によって表される.

ReLU で活性化する 次元の中間層と

次元の出力層から成る 2 層の全結合ニューラルネットワークである.

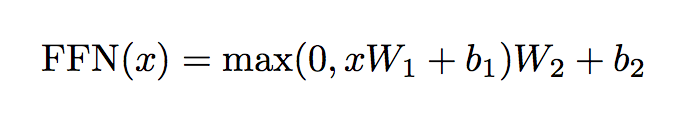

位置エンコーディング

Transformer は RNN や CNN を使用しないので単語列の語順 (単語の相対的ないし絶対的な位置) の情報を追加する必要がある.

本手法では入力の埋め込み行列に位置エンコーディング (Positional Encoding) の行列 を要素ごとに加算する.

位置エンコーディングの行列 の各成分は次式によって表される.

ここで は単語の位置,

は成分の次元である.位置エンコーディングの各次元は波長が

から

に幾何学的に伸びる正弦波に対応する.

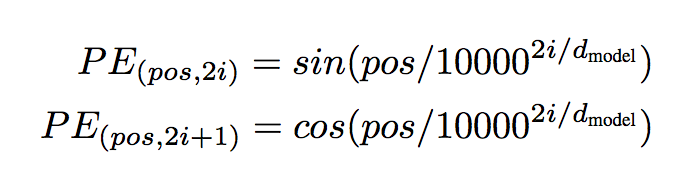

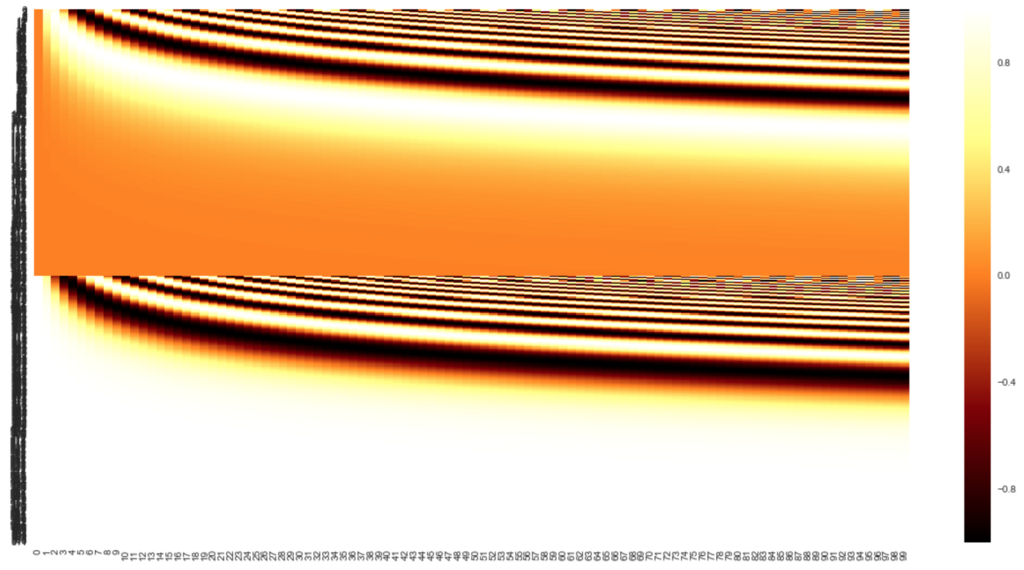

位置エンコーディングを可視化すると次図のとおり (ソース).

横軸が単語の位置 (0 ~ 99),縦軸が成分の次元 (0 ~ 511),濃淡が加算する値 (-1 ~ 1) である.

位置エンコーディングの初出は End-To-End Memory Network (MemN2N) である.質疑応答では複数の入力文を扱うため,入力文の時系列をエンコードする時間エンコーディング (Temporal Encoding) も使用される.

実験

実装は Tensor2Tensor である.

データセットは WMT'14 の英仏 (36M 対訳文) と英独 (4.5M 対訳文) を使用する.希少語に対応するためにソース言語とターゲット言語で語彙を共有した 32000 ピースの Wordpiece (サブワード) を使用する.

8 枚の P100 GPU で訓練した.後述の基本モデル (base) は 1 訓練ステップに約 0.4 秒かかり,全 10 万ステップに 12 時間かかる.また,巨大モデル (big) は 1 訓練ステップに 1 秒かかり,全 30 万ステップに 3.5 日かかる.

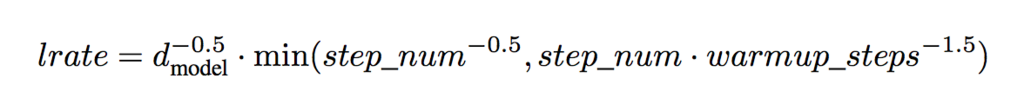

最適化は Adam () を使用し,訓練過程で学習率を変化させる.

この式により,最初の ステップは学習率が線形に増加し,その後は学習率が逆平方根に比例して減少する.

は約

であり,折り返し時の

は約

である.

訓練時は 3 種類の正規化を使用する.

- ラベル平滑化 (Label Smoothing):

のラベル平滑化 [Szegedy, 2015] を適応する.モデルは不確かなラベルを学習するのでパープレキシティは悪化するが,精度と BLEU スコアは向上する.

- 残差ドロップアウト (Residual Dropout): 入力の加算と層正規化 (Add & Norm) 前の各層の出力にドロップアウトを適応する.また,エンコーダとデコーダそれぞれの埋め込みと位置エンコーディングの和にもドロップアウトを適応する.ドロップアウト率は

を使用する.

- 注意ドロップアウト (Attention Dropout): 内積注意の softmax の活性化はフィードフォワードネットワークの隠れ層の活性化のアナロジーと見做すことができる.よって softmax の出力 (注意の重み) にドロップアウトを適応する.

- Rethinking the Inception Architecture for Computer Vision [Christian Szegedy, arXiv, 2015/12]

埋め込み層の辞書行列とソフトマックス層の行列は重み共有する [Press, 2016].

- Using the Output Embedding to Improve Language Models [Ofir Press, arXiv, 2016/08]

評価時はビーム探索 (ビーム幅 ,長さのペナルティ

) を使用する.

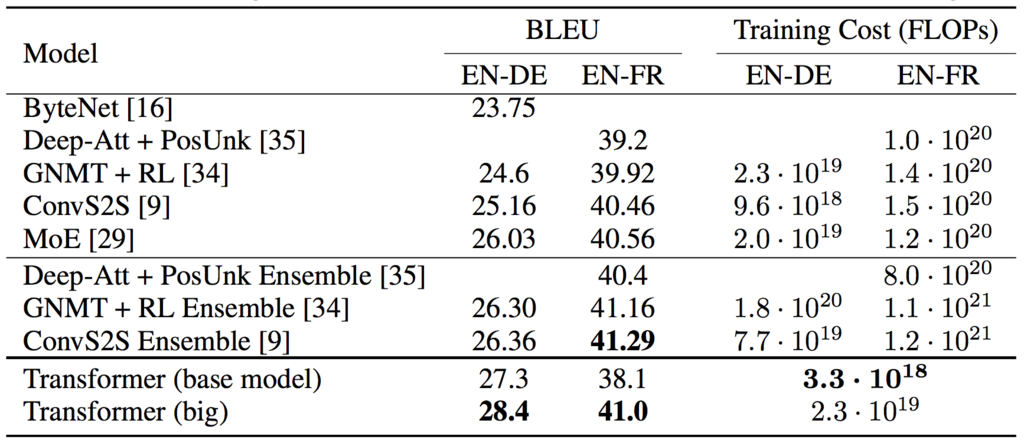

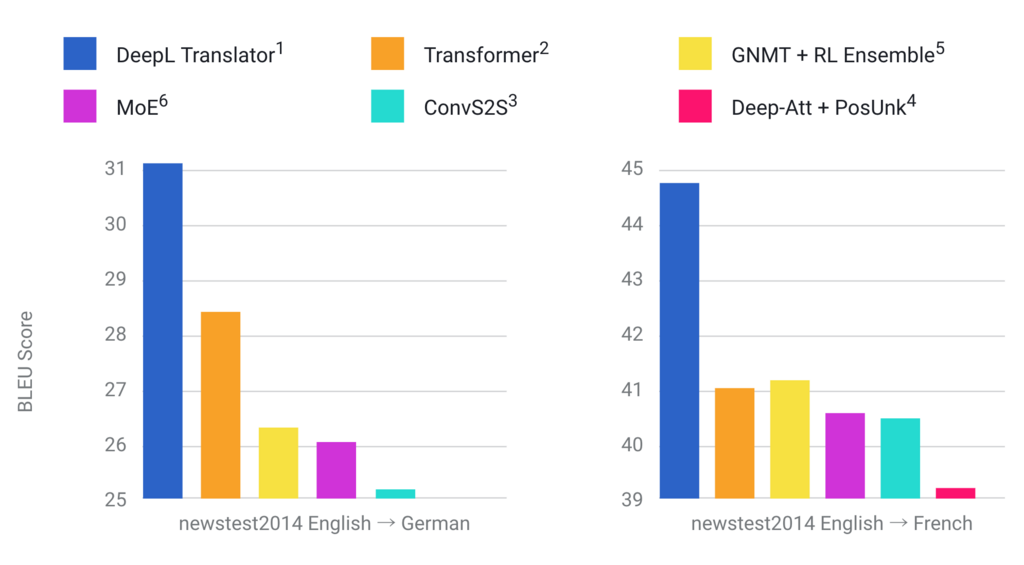

結果

実験結果は次図のとおり.

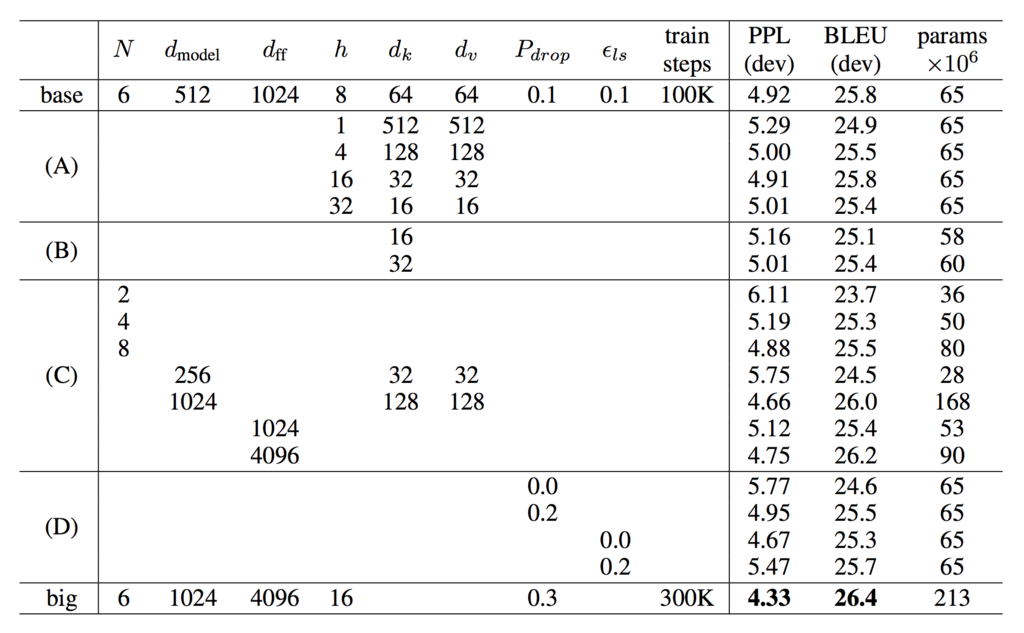

WMT'14 英独は巨大モデル (big) が 28.4 の BLEU スコアを達成した (以前の SOTA より 2.0 高い).基本モデル (base) であっても,非常に少ない訓練コストでアンサンブル学習を含む以前の SOTA より性能が優れている.

WMT'14 英仏は巨大モデル (big) が 41.0 の BLEU スコアを達成し,シングルモデルの以前の SOTA に比べて 1/4 の訓練コストであるにも関わらず性能が優れている.

各要素の重要度を測るために,基本モデル (base) に様々な変更を加えて性能を評価した.また巨大モデル (big) も評価した.

計算量を一定に保ちながら注意ヘッドの数と と

の次元数を変更したところ,単一のヘッドは最高の設定に比べて BLEU スコアが 0.9 も悪く,逆にヘッドが多すぎても性能が落ちた.

自己注意の可視化

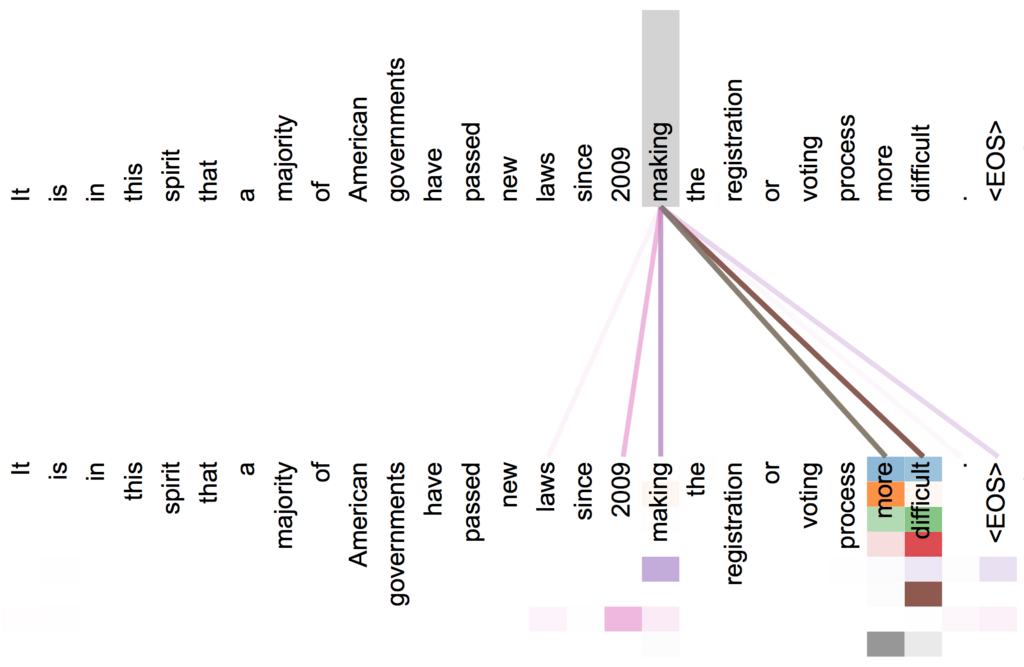

複数ヘッドの自己注意 (エンコーダの第 5 ブロック) を可視化したところ,各ヘッドが構文や意味構造を処理することが判明した.

が

‘making’ のとき 8 個のヘッドの自己注意は次図のとおり.

上段は ,下段は

である.8 色のマーカーの濃淡は 8 個のヘッドの注意の重みの大きさであり,線の色は注意の重みが最大のヘッドを示している.

この例では多くのヘッドが ‘making’ という動詞の長期依存を捉え,‘making...more difficult’ という句を形成している.

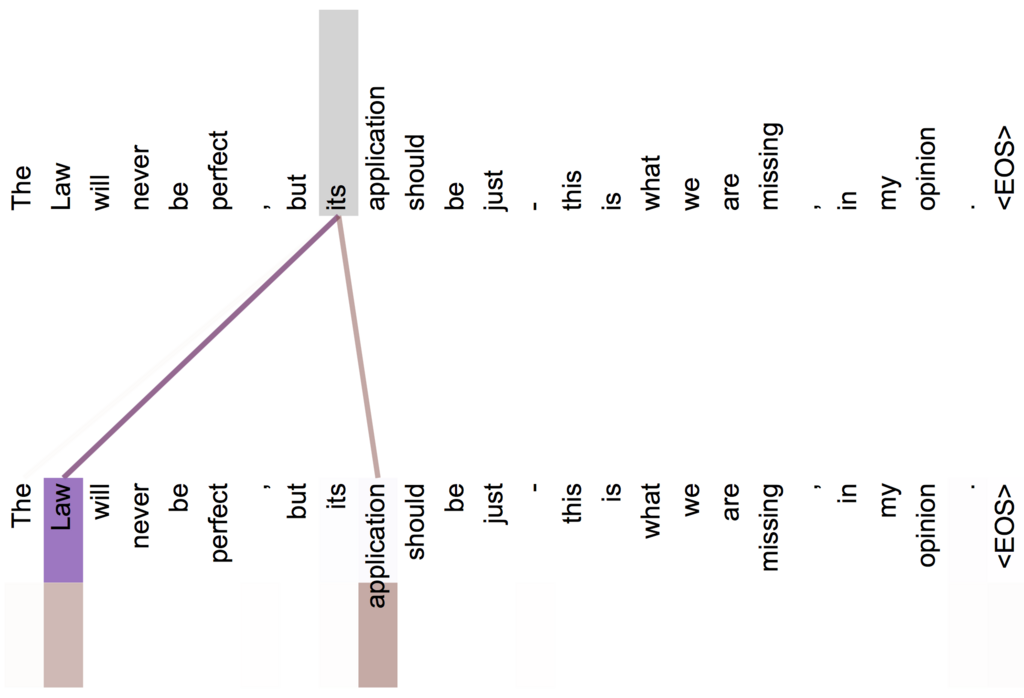

が

‘its’ のとき 2 個のヘッドの自己注意は次図のとおり.

紫色の濃淡は 1 個目のヘッド,茶色の濃淡は 2 個目のヘッドの注意の重みの大きさである.

この例では ‘its’ という代名詞が ‘Law’ という名詞を指すという照応関係を形成している.また,注意の重みが集中している.

自己注意

自己注意の起源は Yoshua Bengio の研究グループが提案した文章の埋め込みベクトルを求める手法である.

- A Structured Self-attentive Sentence Embedding [Zhouhan Lin, last: Yoshua Bengio, arXiv, 2017/03]

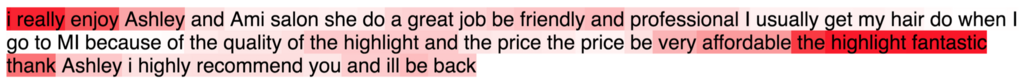

ネガポジ判定用の文を埋め込んだ結果は次のとおり.赤いマーカーの濃淡は注意の重み (Attention Weight) の大きさである.

各単語の埋め込みベクトルを ,自己注意への入力を

とする.

注意の重み は入力

を用いて次式によって表される.

ここで は重み行列である.

入力 から得られた注意の重み

と入力

を内積して文章の埋め込みベクトル

を求める.

つまり,自己注意は入力 を 2 つに複製 (コピー) し,一方の分岐に任意の関数を適応して注意の重み

を求め,分岐を統合 (ie, 内積) する手法であると言える.

ここで全結合と自己注意を比較したい.

| 順伝播 | 逆伝播 | |

|---|---|---|

| 全結合 | |

|

| 自己注意 | |

|

全結合は「重み」と「入力」の内積であり,自己注意は「注意の重み」と「入力」の内積である.

自己注意と他のネットワーク

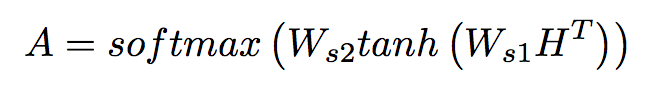

自己注意層と他のネットワーク (リカレント層と畳み込み層) を比較する.

- Complexity per Layer: 1 層あたりの合計の計算複雑性 (複雑性が低いほどスケールアップしやすい)

- Sequential Operations: 系列を処理する最小の操作回数 (操作回数が少ないほど並列化しやすい)

- Maximum Path Length: 任意の入力位置と出力位置を結ぶパスの最大経路長 (パスが短いほど長距離依存を学びやすい)

ここで は単語列の長さ,

は各単語の次元数,

は畳み込みのカーネルサイズ,

は制約自己注意の近傍のサイズである.これらはオーダーが小さいほど優れている.

自己注意層の注意の重みは単語列の長さ の 2 乗オーダーなので

の複雑性がある.一方,リカレント層の重み行列は次元数

の 2 乗オーダーなので

の複雑性がある.

一般的に <

なので,自己注意層はリカレント層より高速である.

自己注意層や畳み込み層は一定の操作回数で処理 (すべての位置を接続) できるが,リカレント層は のタイムステップ操作が必要である.

単一の畳み込み層は <

なので入出力位置の全ペアを接続しない.通常の畳み込み層ないし拡張畳み込み層 (Dilated Convolution) を使用して全ペアを接続するには,それぞれ

と

の層をスタックする必要がある.

制約自己注意は出力位置を中心とするサイズ の近傍に位置する入力単語列のみ計算するので,複雑性が小さくなる代わりに最大経路長が

に増大する.

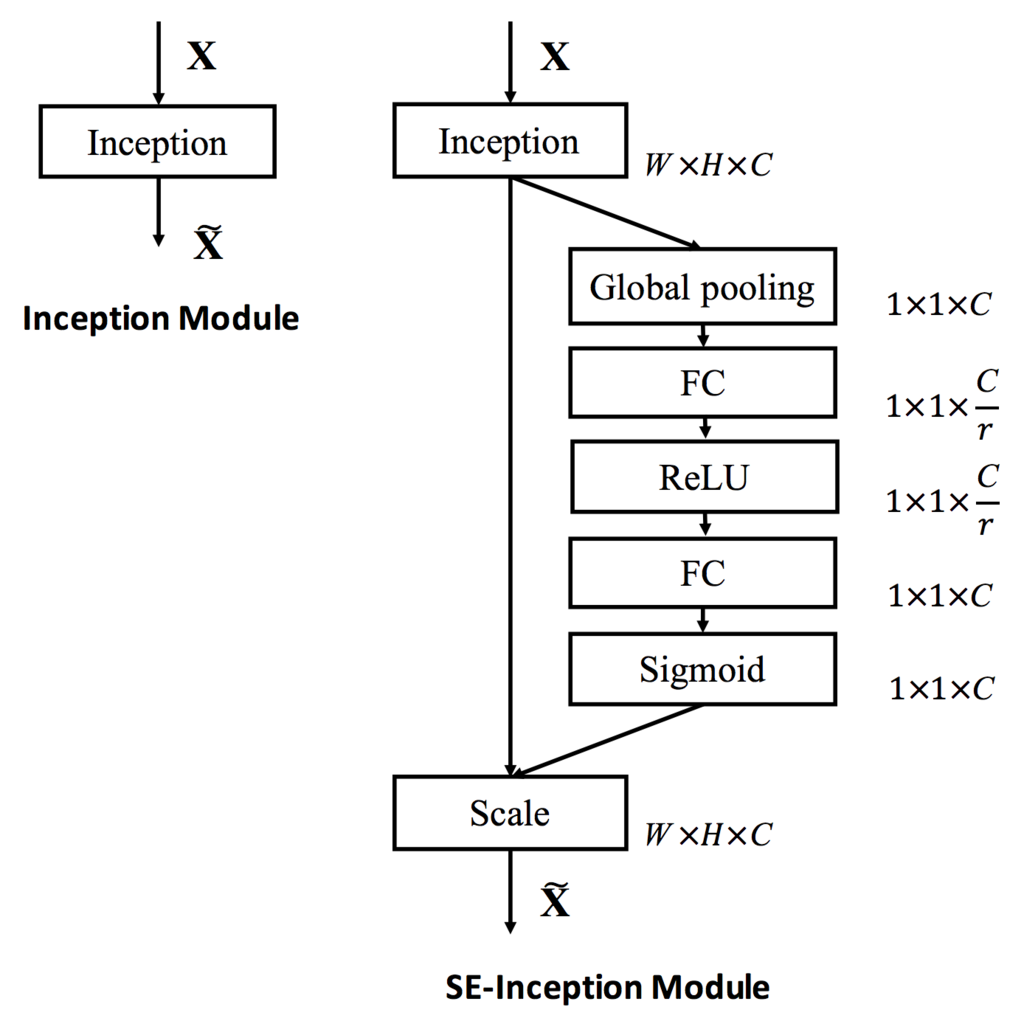

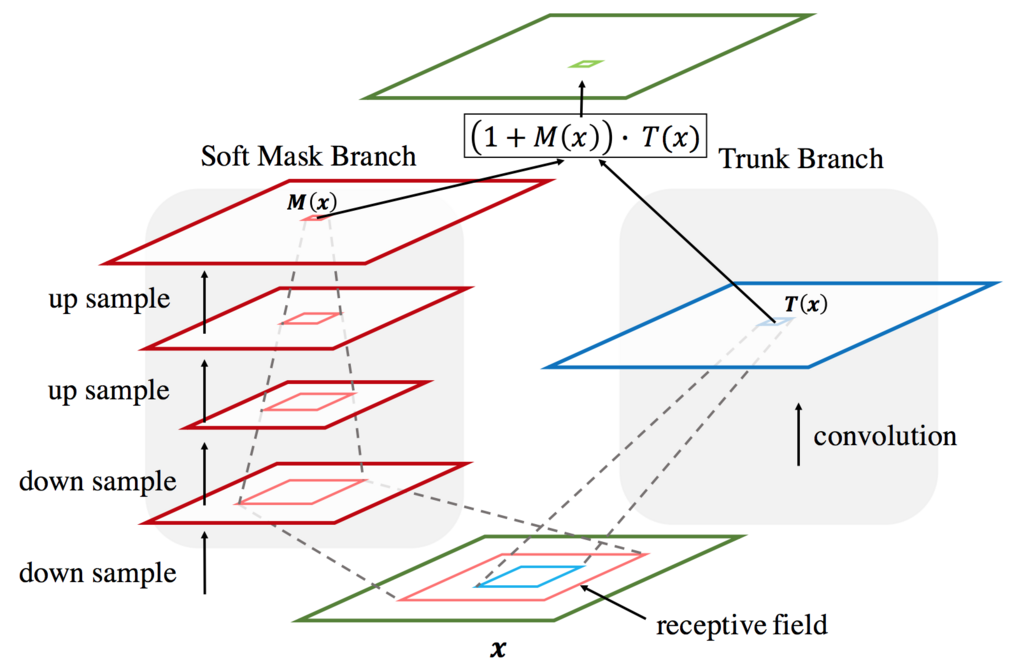

自己注意 ≒ ILSVRC 2017 優勝モデル「圧搾と励起」

自己注意は画像認識の分野でも高い性能が確認されている.

- Squeeze-and-Excitation Networks [Jie Hu, ILSVRC 2017 Winner, arXiv, 2017/09], 著者らのスライド

- Residual Attention Network for Image Classification [Fei Wang, arXiv, 2017/04]

自己注意は同じ場所から来た入力を 2 つに複製し,一方 (もしくは両方) の分岐に任意の関数を適応して「注意の重み」を求め,分岐を統合 (ie, 内積,アダマール積) する手法と解釈できる.

ImageNet で高い性能を発揮した「圧搾と励起ネットワーク」と「残差注意ネットワーク」は自己注意と同じ構造をしている.

| Squeeze-and-Excitation Network | Residual Attention Network |

|---|---|

|

|

圧搾と励起ネットワーク (SENet, Squeeze and Excitation Network) は「どのチャネルを重視するか」という注意の重みを求めてチャネル方向にアダマール積する.注意の重みは「グローバルな情報をチャネルの次元数のベクトルに埋め込む Squeeze」と「ベクトルを再調整する Excitation」から求める.

残差注意ネットワーク (RAN, Residual Attention Network) は「特徴マップのどの部分を注視するか」という注意の重みを求めてアダマール積する.注意の重みは「特徴マップを縮小して文脈を求める bottom-up」と「文脈から各ピクセルの強弱を求める top-down」から求める.

CIFAR と ImageNet のエラー率 SOTA を比較する.

| Method | CIFAR-10 | CIFAR-100 | ImageNet Top-1 | ImageNet Top-5 |

|---|---|---|---|---|

| RAN (Attention-92) | 4.99 | 21.71 | 19.5 | 4.8 |

| RAN (Attention-452) | 3.90 | 20.45 | - | - |

| SENet | - | - | 17.28 | 3.79 |

| Shake-Shake | 2.86 | 15.85 | - | - |

| ShakeDrop | 2.31 | 12.19 | - | - |

- Shake-Shake Regularization [Xavier Gastaldi, arXiv, 2017/05]

- ShakeDrop Regularization [山田良博, OpenReview, 2017/10]

両者のトップは直接比較できないが,畳み込み層の確率的な混合や消去・データ拡張も強いっぽい (ソース).

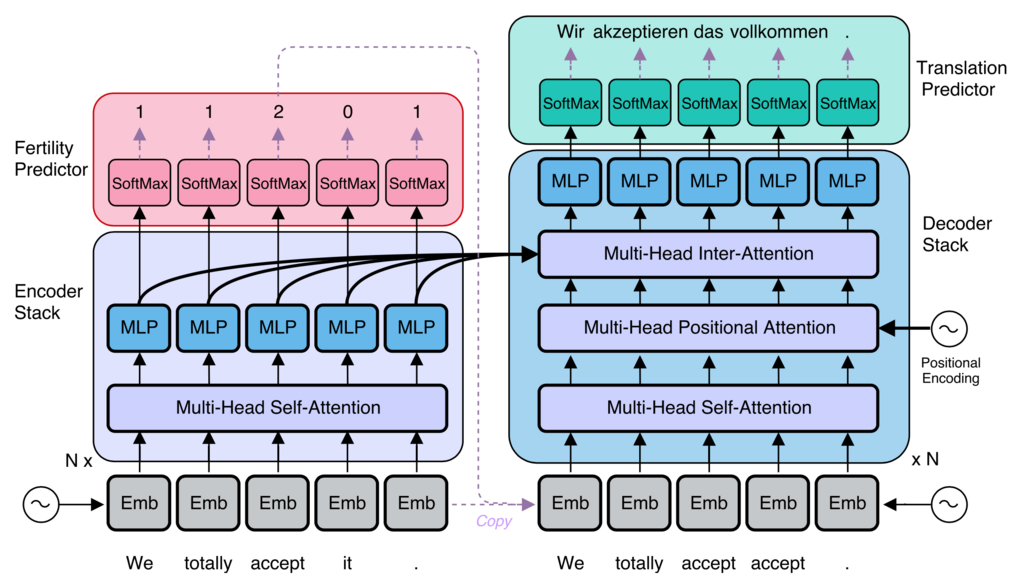

自己回帰を使わない Transformer

- Non-Autoregressive Neural Machine Translation [Jiatao Gu, last: Richard Socher, ICLR 2018]

訓練・推論時ともに自己回帰を使わず高速に翻訳できる Transformer である.モデルは [自己注意, (位置エンコーディング付き) 自己注意, ソースターゲット注意, 位置毎の FFN] のブロックを 層スタックしている.

エンコーダの出力が「エンコーダの入力文からデコーダの入力文にコピーする各単語の数」を求めている (ie, Fertility Prediction).よってデコーダは自己回帰を使用せず予め決まった数の単語を生成する.

DeepL Translator

深層学習はデータ量とマシンパワーで殴るのが正解?

DeepL が衝撃的なプレスリリースを公開した.あまりに BLEU スコアが高すぎて Transformer が霞んで見える.

Google 翻訳より高性能だったので登場時は Google 社内で大問題になったらしい.

- Press Information – DeepL Translator Launch [Gereon Frahling, DeepL, 2017]

DeepL Translator の開発元は対訳文検索エンジン Linguee (2009~) を運営しており,Linguee からクロールした 10 億文で訓練している.大規模コーパスだと言われる WMT'14 英仏 3000 万文,英独 450 万文と比べても非常に巨大な訓練データである.

また,5.1 petaFLOPS (世界ランキング 23 位相当) のスパコンを所有している (PFN の 1024 GPU よりも高火力).すごい.

論文は未公開だが,おそらく巨大な Transformer に近いモデルを使用していると推察される.

残念ながら DeepL Translator は日英翻訳を提供していない.ただし Linguee は日英対訳文を大量に所有しているので今後対応する可能性はある.

また,特許庁と NICT が共同で 3.5 億文の日英対訳データセット (JPO コーパス) を公開している.大規模データの殴り合いが好きな方は申請してみると良さそう.

- JPO・NICT英日対訳コーパス [JPO, NICT]